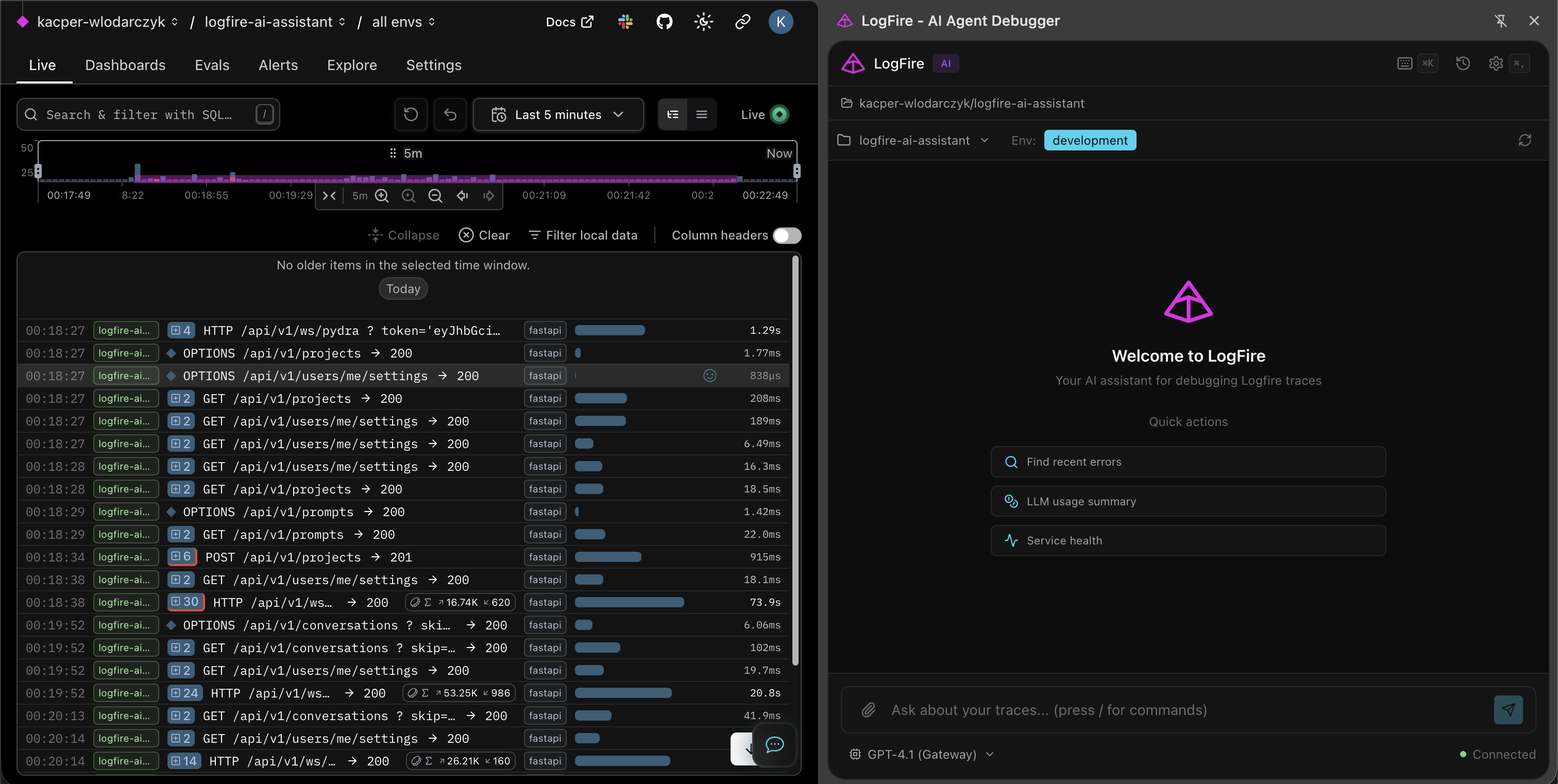

Schluss mit Log-Lesen. Frag deine Traces

in natürlicher Sprache

KI-Debugging-Partner für Pydantic Logfire. Stelle Fragen über deine Traces — erhalte SQL-Abfragen, Datentabellen und Diagramme sofort.

Gebaut mit

FastAPI

FastAPI  Pydantic AI

Pydantic AI  PostgreSQL

PostgreSQL  Redis

Redis  React

React  TypeScript

TypeScript  FastAPI

FastAPI  Pydantic AI

Pydantic AI  PostgreSQL

PostgreSQL  Redis

Redis  React

React  TypeScript

TypeScript Warum es nutzen?

Ohne Logfire Assistant

- ✗ Manuelles Schreiben von SQL-Abfragen gegen Logfire-Schema

- ✗ Kontextwechsel zwischen Logfire-Dashboard und Tools

- ✗ Keine automatische Visualisierung der Ergebnisse

- ✗ Wiederholung häufiger Abfragen aus dem Gedächtnis

- ✗ Keine Konversationshistorie oder Kontext

Mit Logfire Assistant

- ✓ Fragen in natürlicher Sprache stellen

- ✓ Inline-Seitenleiste direkt im Logfire-Dashboard

- ✓ Automatisch generierte Tabellen und Diagramme

- ✓ Wiederverwendbare Prompt-Templates mit Slash-Befehlen

- ✓ Vollständige Konversationshistorie mit Projektfilterung

Alles was du für smarteres Debugging brauchst

Von natürlichsprachigen Abfragen bis zu automatischen Visualisierungen.

Natürlichsprachige Abfragen

Frage nach deinen Traces in natürlicher Sprache. Kein SQL nötig — der Assistent übersetzt automatisch.

Automatische SQL-Generierung

Pydantic-AI-Agent übersetzt Fragen in optimiertes Logfire-SQL. Sieh die Abfrage oder lies die Ergebnisse.

Automatische Visualisierungen

Diagramme und Datentabellen automatisch aus Abfrageergebnissen generiert. Balkendiagramme, Zeitachsen und Zusammenfassungen.

Span-Kontext-Analyse

Klicke auf einen Span in Logfire — der Assistent erfasst trace_id, span_id und vollen Kontext zum Debugging.

Eigene Prompts

Erstelle wiederverwendbare Prompt-Vorlagen mit Slash-Befehlen. Eingebaut: /errors, /costs, /slow, /performance.

Konversationsspeicher

Kompletter Gesprächsverlauf mit Suche und Projektfilterung. Setze jede Debugging-Sitzung fort.

Wie schneidet es ab?

Vergleich mit den Alternativen.

| Funktion | Logfire Assistant | Manuelles SQL | Generischer KI-Chat |

|---|---|---|---|

| Logfire-natives SQL | ✓ | ✓ | ✗ |

| Span-Kontext-bewusst | ✓ | ✗ | ✗ |

| Auto-Diagramme | ✓ | ✗ | ✗ |

| Eigene Prompts | ✓ | ✗ | Partial |

| Konversationshistorie | ✓ | ✗ | ✓ |

| Natürlichsprachige Eingabe | ✓ | ✗ | ✓ |

So funktioniert's

Von der Frage zum Ergebnis in Sekunden.

Stelle eine Frage

Tippe in natürlicher Sprache — "Was waren die langsamsten Requests der letzten Stunde?"

KI generiert SQL

Pydantic-AI-Agent übersetzt deine Frage in optimiertes Logfire-SQL.

Abfrage wird ausgeführt

SQL läuft gegen die Logfire-API. Ergebnisse werden in Echtzeit per WebSocket gestreamt.

Erhalte Einblicke

Datentabellen, Diagramme oder narrative Antworten — genau was du zum Debugging brauchst.

Gebaut für echtes Debugging

Von langsamen Requests bis Kostentracking.

Langsame Requests debuggen

Finde Engpässe sofort. Frage welche Endpoints am langsamsten sind und erhalte Span-für-Span Timing.

- — Endpoint-Latenz-Ranking

- — Span-für-Span Timing

- — Perzentilanalyse (p50, p95, p99)

- — Zeitraum-Vergleich

LLM-Nutzung & Kosten

Token-Nutzung, Kosten und Aufrufzahlen aller LLM-Provider an einem Ort verfolgen.

- — Token-Nutzung pro Modell

- — Kostenaufschlüsselung pro Provider

- — Nutzungstrends über Zeit

- — Automatische Kostendiagramme

Fehleranalyse

Fehlermuster, Häufigkeiten und Ursachen finden. Strukturierte Analyse was schiefgelaufen ist.

- — Fehlerhäufigkeitsmuster

- — Ursachenanalyse

- — Fehlertrends über Zeit

- — Betroffene Endpoints

In Aktion sehen

Eine Chrome-Erweiterung direkt neben deinem Logfire-Dashboard.

Datentabellen

Auto-Diagramme

SQL-Generierung

Span-Kontext

Eigene Prompts

Verlauf

Häufig gestellte Fragen

Alles was Sie über unsere Tools und Projekte wissen müssen.

Was ist Logfire Assistant?

Brauche ich ein Logfire-Konto?

Welche LLM-Anbieter funktionieren?

Kann ich eigene Prompts erstellen?

Werden meine Daten gespeichert?

Bereit, keine Logs mehr Zeile für Zeile zu lesen?

Installiere die Erweiterung, verbinde mit Logfire und stelle deinen Traces Fragen auf Deutsch. Kostenlos und Open Source.