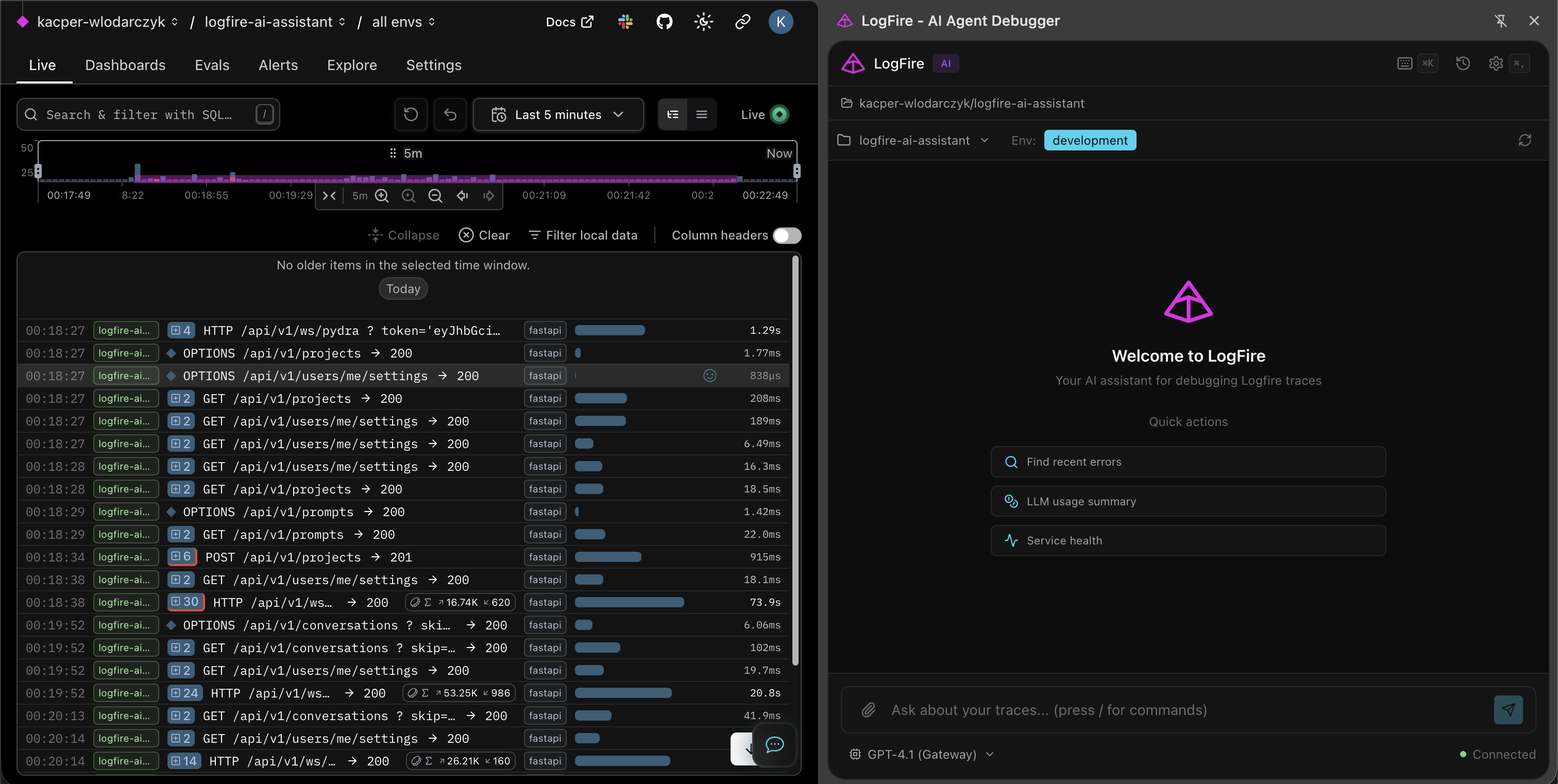

Przestań czytać logi. Pytaj swoje trace'y

w naturalnym języku

Partner do debugowania AI dla Pydantic Logfire. Zadawaj pytania o trace'y — otrzymuj zapytania SQL, tabele danych i wykresy natychmiast.

Zbudowane z

FastAPI

FastAPI  Pydantic AI

Pydantic AI  PostgreSQL

PostgreSQL  Redis

Redis  React

React  TypeScript

TypeScript  FastAPI

FastAPI  Pydantic AI

Pydantic AI  PostgreSQL

PostgreSQL  Redis

Redis  React

React  TypeScript

TypeScript Dlaczego warto?

Bez Logfire Assistant

- ✗ Ręczne pisanie zapytań SQL do schematu Logfire

- ✗ Przełączanie kontekstu między dashboardem a narzędziami

- ✗ Brak automatycznej wizualizacji wyników

- ✗ Powtarzanie częstych zapytań z pamięci

- ✗ Brak historii konwersacji i kontekstu

Z Logfire Assistant

- ✓ Pytaj w prostym języku

- ✓ Panel boczny wbudowany w dashboard Logfire

- ✓ Automatycznie generowane tabele i wykresy

- ✓ Wielorazowe szablony promptów z komendami slash

- ✓ Pełna historia konwersacji z filtrowaniem projektów

Wszystko czego potrzebujesz do debugowania

Od zapytań w języku naturalnym po automatyczne wizualizacje.

Zapytania w języku naturalnym

Pytaj o trace'y po polsku. Nie musisz znać SQL — asystent automatycznie tłumaczy Twoje pytania.

Automatyczne generowanie SQL

Agent Pydantic AI tłumaczy pytania na zoptymalizowany SQL dla Logfire. Podejrzyj zapytanie lub czytaj wyniki.

Automatyczne wizualizacje

Wykresy i tabele danych generowane automatycznie z wyników zapytań. Wykresy słupkowe, osie czasu i podsumowania.

Analiza kontekstu spanów

Kliknij dowolny span w Logfire — asystent przechwyci trace_id, span_id i pełny kontekst do debugowania.

Własne prompty

Twórz szablony promptów ze slash commandami. Wbudowane prompty: /errors, /costs, /slow, /performance i więcej.

Pamięć konwersacji

Pełna historia rozmów z wyszukiwaniem i filtrowaniem projektów. Wznów sesję debugowania tam gdzie skończyłeś.

Jak wypada w porównaniu?

Zobacz jak wypada na tle alternatyw.

| Funkcja | Logfire Assistant | Ręczny SQL | Generyczny czat AI |

|---|---|---|---|

| Natywny SQL Logfire | ✓ | ✓ | ✗ |

| Świadomość kontekstu Span | ✓ | ✗ | ✗ |

| Automatyczne wykresy | ✓ | ✗ | ✗ |

| Własne prompty | ✓ | ✗ | Partial |

| Historia konwersacji | ✓ | ✗ | ✓ |

| Wejście w języku naturalnym | ✓ | ✗ | ✓ |

Jak to działa

Od pytania do wglądu w sekundy.

Zadaj pytanie

Pisz w naturalnym języku — "Jakie były najwolniejsze requesty w ostatniej godzinie?"

AI generuje SQL

Agent Pydantic AI tłumaczy pytanie na zoptymalizowany SQL dla Logfire.

Zapytanie się wykonuje

SQL wykonuje się na Logfire API. Wyniki strumieniowane w czasie rzeczywistym przez WebSocket.

Otrzymujesz wgląd

Tabele danych, wykresy lub odpowiedzi opisowe — dokładnie to czego potrzebujesz.

Stworzony do debugowania

Od wolnych requestów po śledzenie kosztów.

Debugowanie wolnych requestów

Znajdź wąskie gardła natychmiast. Zapytaj które endpointy są najwolniejsze i otrzymaj rozbicie czasu span po spanie.

- — Ranking opóźnień endpointów

- — Timing span po spanie

- — Analiza percentyli (p50, p95, p99)

- — Porównanie okresów czasu

Użycie LLM i koszty

Śledź użycie tokenów, koszty i liczbę wywołań u wszystkich providerów LLM w jednym miejscu.

- — Użycie tokenów per model

- — Rozbicie kosztów per provider

- — Trendy użycia w czasie

- — Automatyczne wykresy kosztów

Analiza błędów

Znajdź wzorce błędów, częstotliwość i pierwotne przyczyny. Strukturalna analiza co poszło nie tak.

- — Wzorce częstotliwości błędów

- — Analiza pierwotnych przyczyn

- — Trendy błędów w czasie

- — Mapowanie dotkniętych endpointów

Zobacz w akcji

Rozszerzenie Chrome żyjące tuż obok Twojego dashboardu Logfire.

Tabele danych

Automatyczne wykresy

Generowanie SQL

Kontekst spanów

Własne prompty

Historia

Często zadawane pytania

Wszystko co musisz wiedzieć o naszych narzędziach i projektach.

Czym jest Logfire Assistant?

Czy potrzebuję konta Logfire?

Którzy dostawcy LLM działają?

Czy mogę tworzyć własne prompty?

Czy moje dane są przechowywane?

Masz dość czytania logów linijka po linijce?

Zainstaluj rozszerzenie, połącz z Logfire i zadawaj pytania swoim trace'om po polsku. Za darmo i open-source.